Descente de gradient stochastique avec estimateur de gradient pour variables catégoriques

Le vaste domaine du machine learning (ML) offre un large éventail de techniques et de méthodes couvrant de nombreuses situations. La supply chain, cependant, présente son propre ensemble de défis en matière de données, et parfois, des aspects jugés « basiques » par les praticiens de la supply chain ne bénéficient pas d’instruments ML satisfaisants – du moins selon nos critères. Telle fut la situation des variables catégoriques, qui sont omniprésentes dans la supply chain – par exemple, pour représenter des catégories de produits, des pays d’origine, des modes de paiement, etc. Ainsi, quelques-uns d’entre nous ont décidé de revisiter la notion de variables catégoriques sous l’angle de la programmation différentiable.

Dans la supply chain, les variables catégoriques sont fréquemment absentes, non pas parce que les données sont inconnues, mais parce que la catégorisation elle-même n’a pas toujours de sens. Par exemple, la coupe (droite / ajustée / slim / etc.) s’applique aux pantalons mais pas aux ceintures. Ainsi, la distinction entre « données manquantes » et « données non applicables » peut sembler subtile, mais demeure importante. C’est ce type de distinction qui différencie un modèle bien comporté d’un modèle présentant un comportement étrange.

L’article ci-dessous présente une contribution de Paul Peseux (Lokad), Victor Nicollet (Lokad), Maxime Berar (Litis) et Thierry Paquet (Litis).

Title: Descente de gradient stochastique avec estimateur de gradient pour variables catégoriques

Authors: Paul Peseux, Maxime Berar, Thierry Paquet, Victor Nicollet

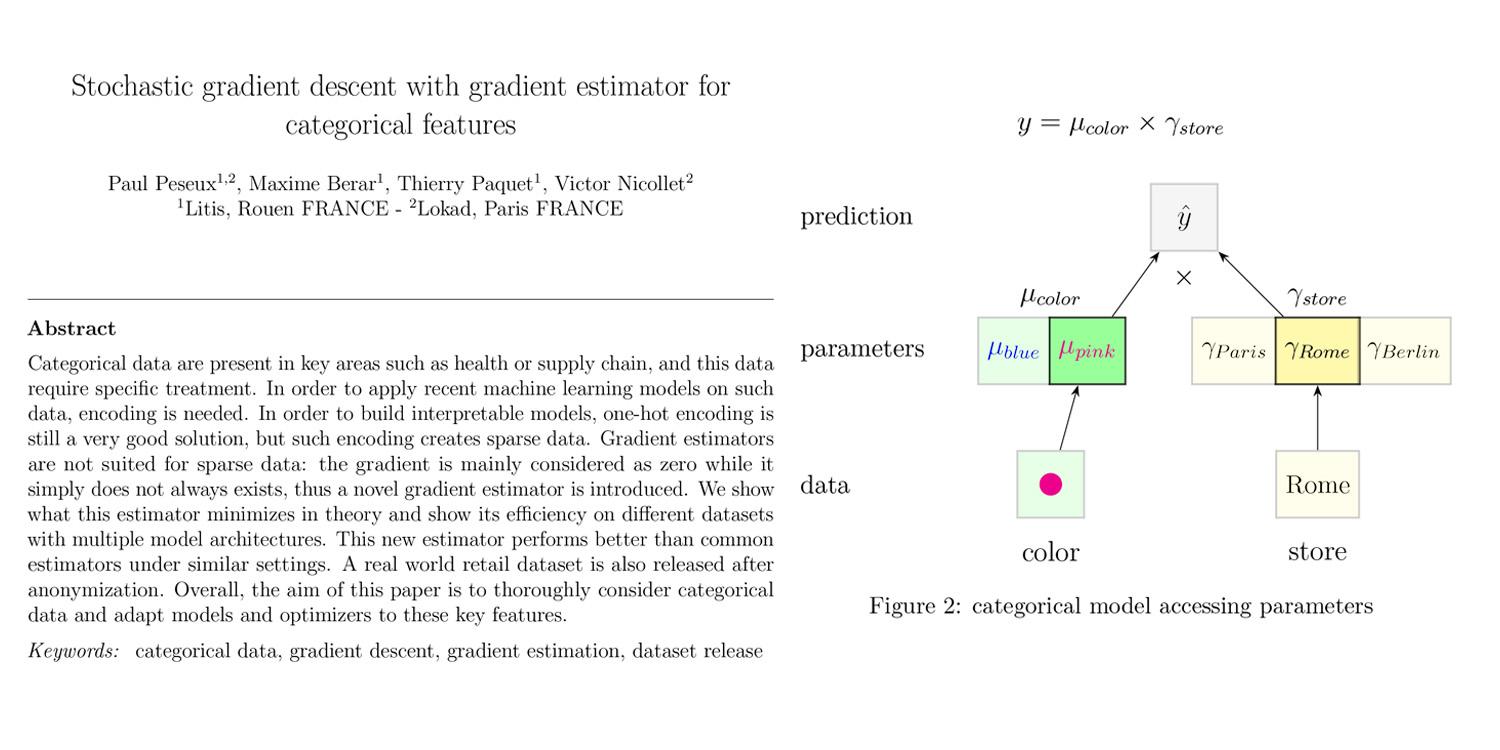

Abstract: Les données catégoriques sont présentes dans des domaines clés tels que la santé ou la supply chain, et ces données nécessitent un traitement spécifique. Pour appliquer aux données des modèles ML récents, un encodage est nécessaire. Afin de construire des modèles interprétables, l’encodage one-hot demeure une très bonne solution, mais cet encodage crée des données creuses. Les estimateurs de gradient ne conviennent pas aux données creuses : le gradient est principalement considéré comme nul alors qu’il n’existe tout simplement pas toujours, c’est pourquoi un nouvel estimateur de gradient est introduit. Nous montrons ce que cet estimateur minimise en théorie et démontrons son efficacité sur différents jeux de données avec de multiples architectures de modèles. Ce nouvel estimateur performe mieux que les estimateurs courants dans des conditions similaires. Un jeu de données de vente au détail du monde réel est également publié après anonymisation. Dans l’ensemble, le but de cet article est d’examiner en profondeur les données catégoriques et d’adapter les modèles ainsi que les optimisateurs à ces caractéristiques clés.